Artificiell Intelligens (AI) har på senare år medfört en betydande inverkan på juridiken, och integrationen av denna teknologi i juridisk praxis har väckt en rad etiska överväganden. När AI används för att underlätta eller stödja juridiska beslut och processer uppstår frågor om rättvisa, ansvar och transparens som måste hanteras.

The AI Act – AI-lagen som ska reglera AI-teknologins användning

En viktig milstolpe inom EU är The AI Act, en lagstiftning som syftar till att reglera användningen av AI-teknologi och säkerställa etisk användning. Lagen fastställer regler för olika typer av AI-system och identifierar högriskanvändningar som kräver särskild uppmärksamhet och övervakning. Genom att fastställa tydliga regler och riktlinjer försöker lagen The AI Act balansera innovation med skyddet av individens rättigheter och samhällsintressen.

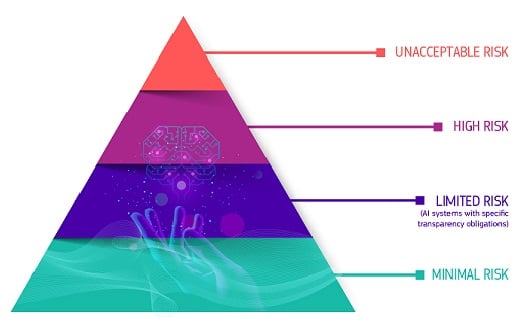

The AI Act definierar 4 nivåer av risk med AI:

En viktig fråga är risken för att AI kan förstärka redan befintlig orättvisa och diskriminering inom rättssystemet. AI-system är tränade på historiska data och baserar följaktligen sin output på det. Om denna data är partisk eller innehåller fördomar leder det till diskriminering. Det är därför viktigt att noggrant utvärdera AI-systemens uppbyggnad, kod och prestanda för att upptäcka och korrigera eventuella orättvisor eller partiskhet. Det är också viktigt att säkerställa att materialet som AI-systemet utgår ifrån är av så hög kvalité som möjligt när det gäller opartiskhet och korrekthet.

– Det är viktigt att vara medveten om potentiella fördomar och mänskliga rättigheter när man utvecklar och använder AI. Det kanske inte är möjligt att ta bort dem alla eftersom de finns i data, men då bör lösningarna åtminstone ta hänsyn till riskerna och ha ett sätt att säkerställa att fördomarna inte läggs till i beslutsfattandet baserat på AI-lösningen, säger Maiken Sundahl Jakobsen, Nordic Data Protection & Compliance Manager, Norstedts Juridik och Karnov Group. En annan central fråga är hur man balanserar automatisering med mänsklig bedömning och ansvar. Det krävs en kombination av teknisk expertis, juridisk kunskap och etiskt tänkande för att säkerställa en ansvarsfull användning av AI inom juridiken. Det blir därför avgörande att ha en integrerad strategi för att navigera och adressera etiska problem och konsekvenser relaterade till AI-teknologier.

En annan central fråga är hur man balanserar automatisering med mänsklig bedömning och ansvar. Det krävs en kombination av teknisk expertis, juridisk kunskap och etiskt tänkande för att säkerställa en ansvarsfull användning av AI inom juridiken. Det blir därför avgörande att ha en integrerad strategi för att navigera och adressera etiska problem och konsekvenser relaterade till AI-teknologier.

– Det är viktigt att inte bara se AI som en rent teknisk lösning utan också som ett etiskt dilemma. Vi måste vara medvetna om de potentiella riskerna och konsekvenserna av att använda AI inom juridik såväl som andra discipliner och alltid komma ihåg att ställa oss frågan; Finns det några etiska risker och konsekvenser att ta hänsyn till, innan vi utformar eller använder lösningen, avslutar Maiken Sundahl Jakobsen.

Vad är The AI Act?

The AI Act fastställer skyldigheter för leverantörer och användare beroende på den risknivå som AI kan generera. Lagförslaget klassificerar och delar in AI i olika riskklasser, till exempel förbjuden AI och AI-system med högrisk. Beroende på riskklass måste de bolag som utvecklar och/eller använder AI uppfylla och efterleva vissa specifika krav. The AI Act syftar till att säkerställa att EU:s medborgares rättigheter tillgodoses samtidigt som innovation främjas. Som utvecklande bolag är det därför viktigt att ta höjd för de krav som ställs i AI Act tidigt i produktutvecklingen. Lika viktigt är det, om man är ett bolag eller organisation som köper in en produkt med en AI-komponent, att genomföra en undersökning av produkten och komponenten för att säkerställa att den uppfyller alla lagkrav.

Vad innebär The AI Act i praktiken?

Vad ett bolag måste göra innan AI lanseras eller används i verksamheten beror på vilken riskklass som AI:n omfattas av. Ett bolag som avser använda AI bör, som ett första steg, göra en bedömning av riskklass, och därefter göra en riskanalys avseende AI:n och dess användning. Innan lansering bör bolaget även ha risk management-processer samt ett ramverk för kontroll och styrning på plats, som säkerställer efterlevnad av AI Act inom organisationen. Dessutom behöver bolaget kunna redogöra på ett transparent sätt rörande AI-produktens funktioner och eventuell påverkan på individer. Oavsett lagkrav bör dessutom alla som avser använda AI säkerställa att AI:n används på ett ansvarsfullt och etiskt vis. AI kan öppna upp för sårbarheter i organisationen som man tidigare inte utsatts för. Därför bör företag även se över cybersäkerhetsrisker och hur AI:n kan öppna upp för integritetsrisker.

Vem träffas av regleringen?

The AI Act är, likt GDPR, tillämplig på alla bolag som erbjuder sina tjänster till EU-medborgare och får därigenom global påverkan som kommer att kräva omställningsarbete för ett flertal multinationella bolag som erbjuder sina tjänster inom EU.

Så påverkar AI personlig integritet

AI kan påverka den personliga integriteten både positivt och negativt. Å ena sidan kan AI användas som ett verktyg för att förbättra säkerheten och skydda personuppgifter. Å andra sidan kan AI också användas för att samla in och analysera stora mängder personlig data, vilket kan vara en risk för individens integritet. För en säker implementering av AI-teknik krävs att verksamheten har ett etiskt förhållningssätt till AI och implementerar tydliga styrnings- och uppföljningsprocesser.

|